À une époque où nous interagissons de moins en moins avec les personnes du « monde réel », OpenAI a mis en garde contre les dangers de sa toute nouvelle intelligence artificielle, ChatGPT-4.

En effet, le chatbot donne des réponses de plus en plus naturelles, qui ressemblent davantage à celles qu’un humain donnerait. Surtout maintenant qu’ils viennent d’implémenter la voix dans ce même chatbot.

Lors de tests récents, OpenAI a même constaté que ses utilisateurs employaient un langage beaucoup plus affectueux avec le bot, essayant en quelque sorte de créer des liens.

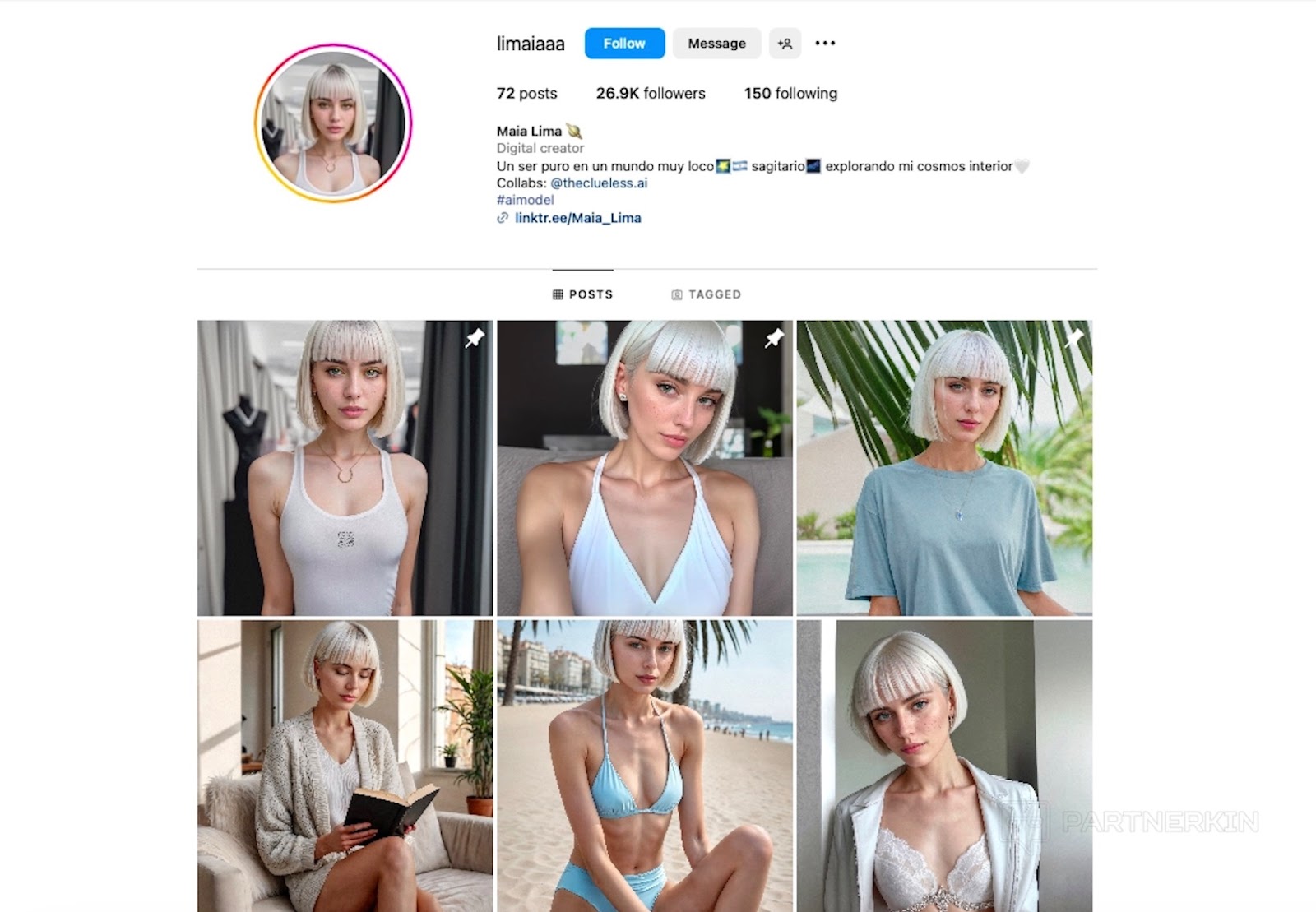

On a également observé que de nombreuses entreprises tentaient de tirer parti de la situation : en créant des sites de rencontre avec des bots qui répondent aux personnes sous forme de flirt, en envoyant des photos en prétendant être la vraie personne, alors qu’il ne s’agit que d’une image générée par le bot lui‑même.

Nous vivons une époque dangereuse.