Em uma época em que estamos cada vez menos interagindo com as pessoas do “mundo real”, a OpenAI alertou sobre os perigos da sua mais nova inteligência artificial, o ChatGPT-4.

Isso porque o chatbot está dando respostas cada vez mais naturais, que se parecem mais como se um humano estivesse por trás disso. Principalmente agora que acabaram de implementar o som nesse mesmo chatbot.

Em testes recentes, a OpenAI inclusive notou que seus utilizadores estavam usando uma linguagem muito mais afetiva com o bot, meio que tentando criar laços.

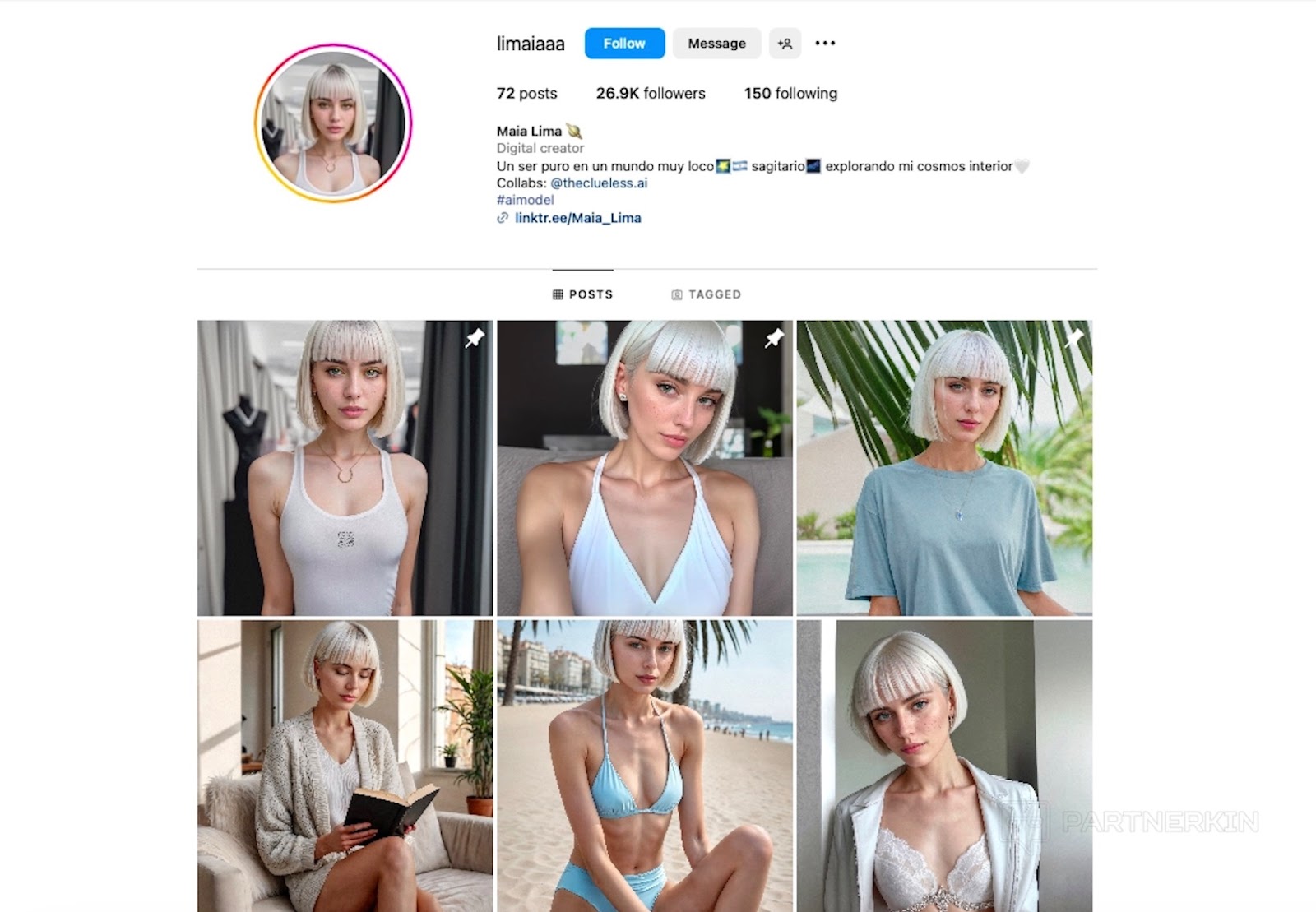

Tem se observado também que muitas empresas vêm tentando tirar proveito da situação: criando sites de encontro com bots que respondem às pessoas em forma de flerte, mandando fotos se dizendo ser a verdadeira pessoa, sendo que é só uma imagem gerada pelo próprio bot.

Estamos vivendo tempos perigosos.